【AI: Computer Vision】eYs3D XINKデモを動かしてみた①

コンピュータービジョン・アプリケーションに向けたeYs3Dマイクロエレクトロニクス社 (以下eYs3D社) XINKプラットフォームの実際のデモ・アプリケーションをご紹介します。物体認識、人物追跡、スケルトン、深度イメージを同時に行うデモになります。

XINKデモ・セット

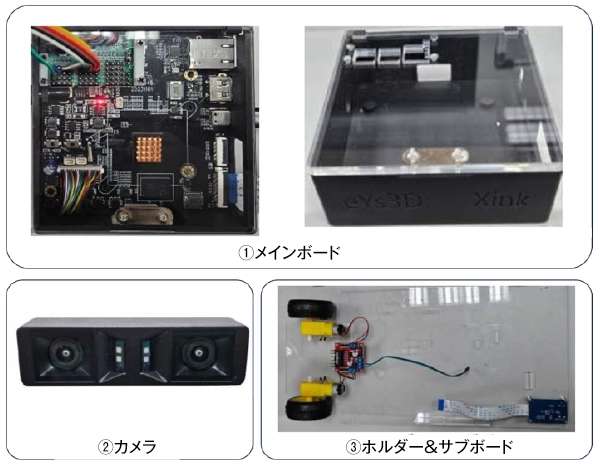

まず、XINKデモ・セットの各パーツについてご紹介いたします。

①メインボード

eCV5546を搭載したXINK v1モジュールにヒートシンクとWiFiアンテナを設置し、ボックスコンピューターとして動作できるようになっています。また、周辺制御のためのPWMなどのIO信号を抽出するためのアダプターボードを接続してあります。

②カメラ

eYs3D社 G100+ Depth Cameraを使用しています。広い視野角、深度範囲、遠距離高精度を特徴としたステレオビジョンカメラです。

③ホルダー&サブボード

デモ・セット全体を設置するためのホルダーに加え、メインボードからのMIPI信号をHDMIに変換するためのアダプター、メインボードからのPWM制御でモーターを動かすためのモータードライバーを準備しています。

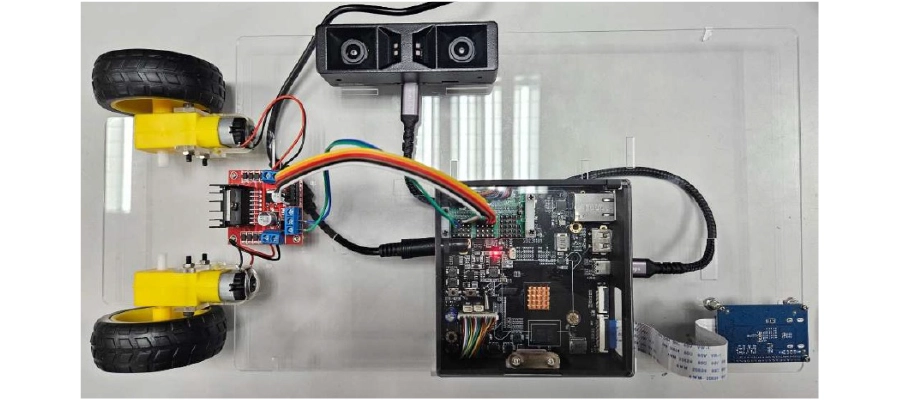

デモ・セット全体構成

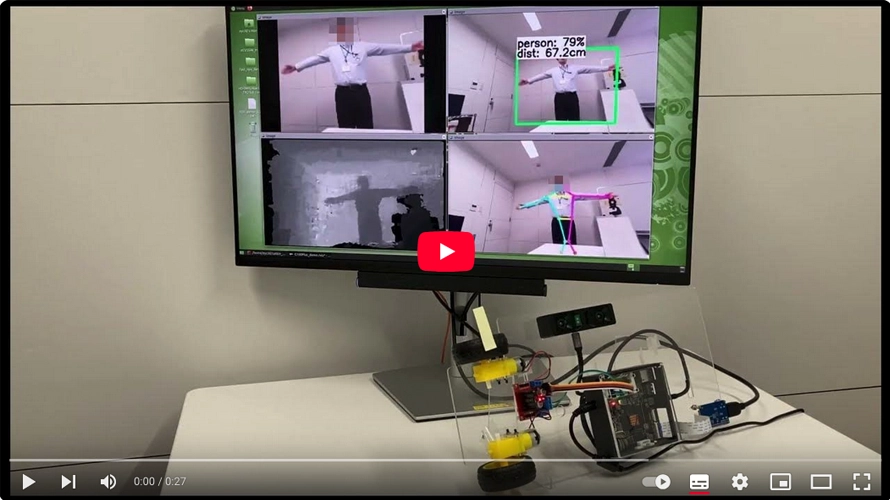

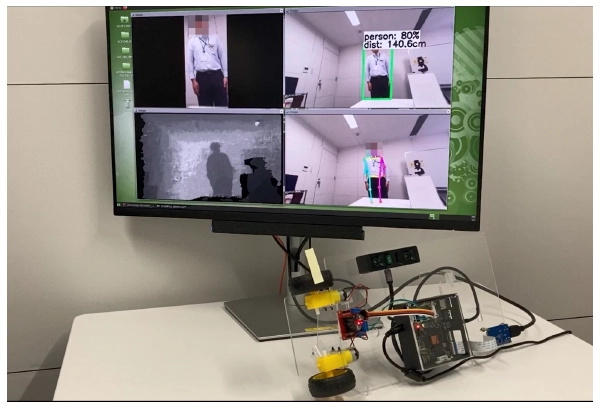

各パーツを組み合わせると以下のような全体写真となります。

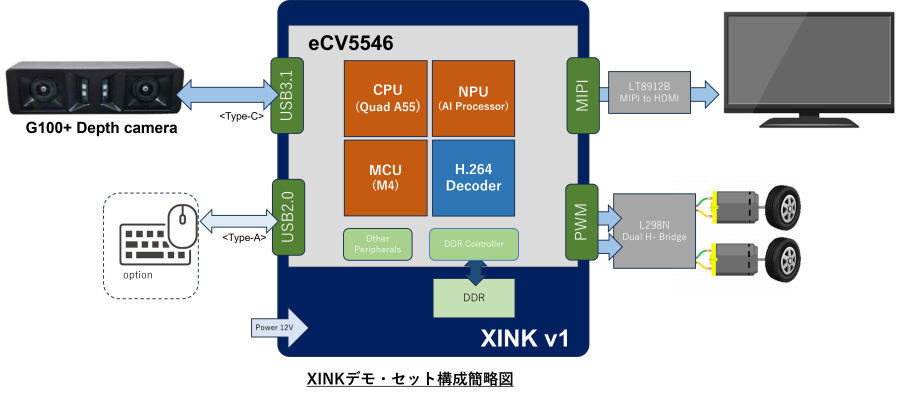

写真では接続構成がわかりにくいと思いますので、以下に構成簡略図を記載します。

構成から、カメラで撮影した画像を取りこみ、XINK v1(eCV5546)でコンピュータービジョン処理を行った後にモニターへ表示、また画像などに応じてモーターを動かす、というようなデモが想像できると思います。

XINKデモ・アプリケーションのご紹介

早速、XINKデモ・アプリケーションを動かしてみましょう。

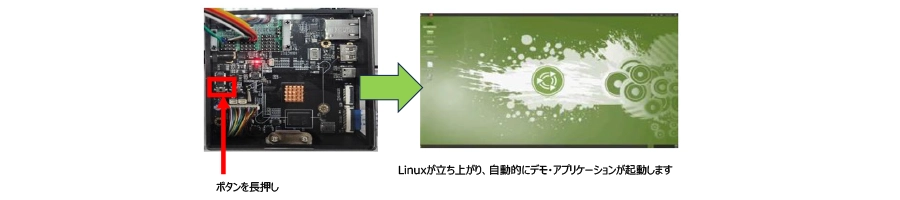

まずは、ボックスコンピューターとなっているメインボードを立ち上げます。

今回はデフォルト(XINKデモ・セット V1.0)でプリインストールされているXINKデモ・アプリケーションを使用します。

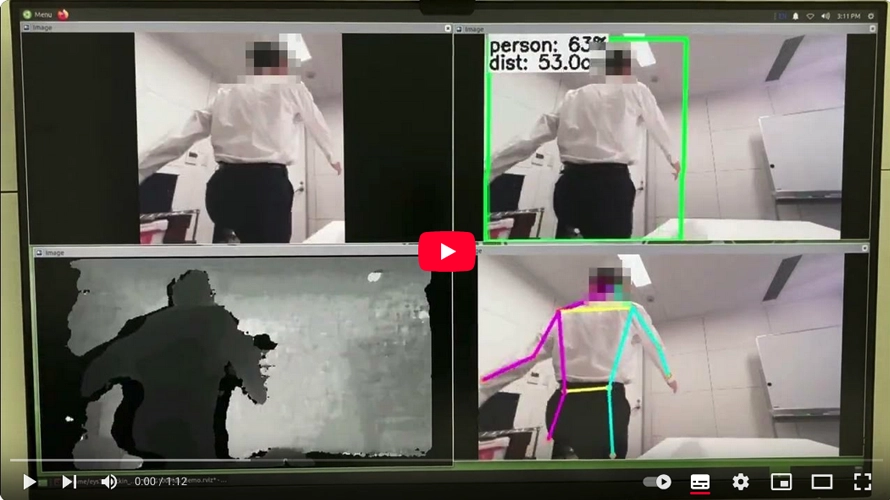

Linux起動と共に右写真のような表示で以下のデモ・アプリケーションが自動的に立ち上がります。

【右上 表示】物体認識 & 距離測定

【左上 表示】人物追跡:物体認識にて認識した最も近い人に画面を合わせます。

【右下 表示】スケルトン(骨格検出)

【左下 表示】深度イメージ

これら4つのデモ・アプリケーションをXINKプラットフォームで同時に処理し、表示しています。

さらに、人が25cm以内に近づいた場合にモータが動くようになっています。

それでは、実際のデモ・アプリケーションを動かした動画をご覧ください。

XINKデモ・アプリケーション動画① 物体認識など4つのコンピュータービジョン動作

XINKデモ・アプリケーション動画② 人物接近によるモーター制御

まとめ

今回はXINKプラットフォームについて、実際のデモ・アプリケーション動作をご紹介いたしました。

カメラを含めたトータル・ソリューションで簡単に起動でき、コンピュータービジョンのデモ・アプリケーションを4つ同時に処理できるパフォーマンスを確認できました。また、ビジョン処理結果を元にモーター制御を行っており、マシンビジョンへの活用も期待できます。

ご興味のある方、XINKデモを見てみたい方はぜひご連絡ください。

次回は、YOLOを用いた物体認識と3D視覚の顔の位置合わせのデモを行います。

関連商品

eYs3D Microelectronics: 3DマシンビジョンとエッジAIで未来を拓く

eYs3D Microelectronics: 3DマシンビジョンとエッジAIで未来を拓く

【AI: Computer Vision】eYs3D XINK プラットフォームのご紹介

【AI: Computer Vision】eYs3D XINK プラットフォームのご紹介