「AI活用」と「情報漏えい対策」のジレンマを解消。事例で紐解くPrompt Securityの導入ROIと将来性

「社員が現在、どの生成AIサービスを利用し、どのようなデータを入力しているか」——この実態を正確に把握できている企業は、決して多くありません。業務効率化に向けたChatGPTやGitHub Copilotの導入が進む一方で、組織の管理外にある「シャドーAI」の利用や、プロンプト経由での機密情報の入力といったリスクが、水面下で拡大しています。一律に利用を「禁止」すれば安全性は担保されますが、それは業務革新の機会を損なうだけでなく、監視の目を盗んだ利用(抜け道)を誘発する可能性があります。

しかし、この「セキュリティと利活用のジレンマ」を解消し、機密データを扱う金融機関でありながら全社的なAI導入を成功させた事例があります。英国の10x Banking社です。同社が厳格な規制下でCopilot等の利用を許可できた背景には、従来の一律禁止や既存のDLP(情報漏えい対策)では困難な、プロンプトの文脈理解と個人情報の自動マスキングを実現する「Prompt Security」の導入がありました。

本レポートでは、同社やRiskified社の成功事例を基に、セキュリティ部門が「規制を中心とする管理者(ゲートキーパー)」から「ビジネスを支援・促進する存在」へと変革するための、現実的なロードマップと具体的ソリューションを提示します。

「生成AIセキュリティプラットフォーム」の紹介はこちら

お問い合わせはこちら

|

目次

|

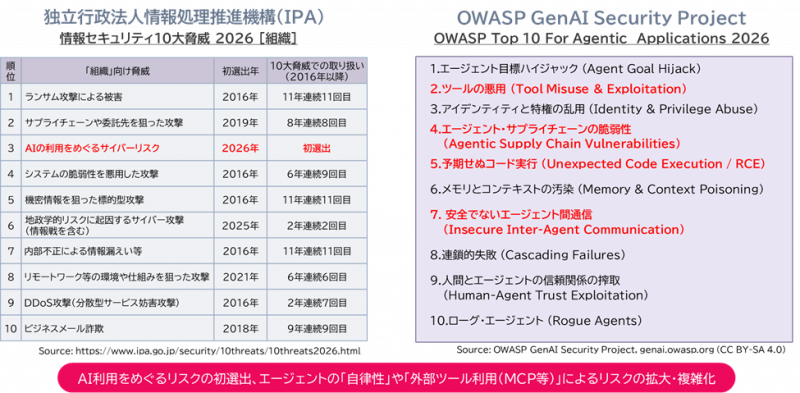

1. 生成AI活用における「見えないリスク」の正体:シャドーAIと脱獄の脅威

企業のデジタルトランスフォーメーション(DX)において、生成AIの活用は「導入の是非」を問う段階を超え、「いかに安全に活用するか」というフェーズに移行しています。しかし、現場の情報システム担当者が抱える懸念は払拭されていません。その要因は、従来のITツールとは異なる、生成AI特有の「可視化されにくいリスク」にあります。これらは従来の境界防御(ファイアウォール等)の内側で発生し、通常の業務フローに混在しているため、発見が困難です。

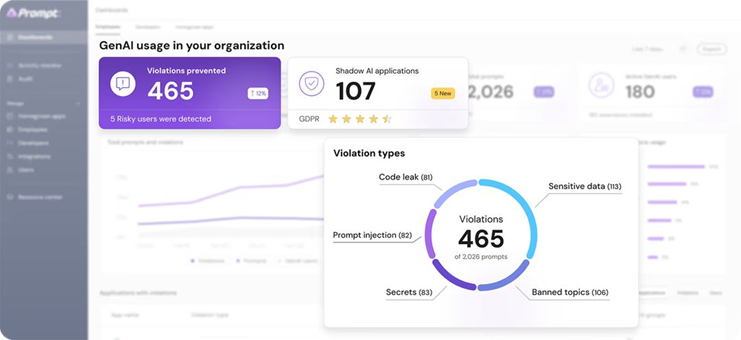

1.1. 管理外の「シャドーAI」の増加:数値が示す実態

組織にとって深刻な課題の一つが「シャドーAI」です。社員が業務効率化を目的として、会社が認可していない無料のAIツールや、個人契約の生成AIサービスを独自の判断で利用するケースです。

2025年の調査データによると、企業のWebトラフィックにおける生成AIサイトへのアクセスは前年比で50%以上増加しており、その多くがブラウザ経由で行われています。これは、公式ツールだけでなく、多数の未承認ツールへのアクセスが含まれていることを示唆しています。また、IBMのレポートによれば、シャドーAIに起因するデータ侵害が発生した場合、通常のデータ侵害よりも平均して67万ドル(約1億円)高いコストが発生するという結果が出ています。

コストが増大する主な要因は、シャドーAI経由で流出したデータの追跡や、学習利用の有無を確認することが極めて困難であるためです。社員に悪意がなくとも、業務遂行のために顧客リストや独自のソースコード、未公開の財務データなどを入力してしまう——これが現在の日本企業で起きている実態です。ブラウザの履歴のみでは、具体的に「どのようなプロンプト(データ)が送信されたか」までは把握できません。1.2. AIから情報を引き出す「脱獄(Jailbreak)」のメカニズム

もう一つのリスクは、外部からの攻撃、あるいは内部からの意図的な操作による「脱獄(ジェイルブレイク)」です。 通常、LLM(大規模言語モデル)には倫理的・セキュリティ的なガードレール(安全装置)が設けられています。しかし、特殊なプロンプト(指示)を入力することで、この制限を回避する手法が存在します。

- ロールプレイング攻撃(DANなど): AIに対して特定のキャラクターを演じさせることで、本来の安全装置を無視させる手法。

- 多段階プロンプト(Multi-shot Jailbreaking): 無害に見える質問を繰り返し、徐々にAIのコンテキストを誘導して、最終的に禁止されている情報を出力させる手法。

- 難読化とエンコーディング: 指示をBase64などのコードに変換したり、アスキーアートの中に指示を隠したりして、検知フィルターを回避する手法。

一度「脱獄」に成功したAIは、社内の機密情報であっても出力してしまう恐れがあります。これは、従来のシグネチャベースの検知システムでは捉えきれない、AIモデル特有の脆弱性です。

1.3. 従来のセキュリティ対策とのギャップ

これらのリスクに対し、多くの企業は「URLフィルタリングでの一律禁止」か「DLP(情報漏えい対策ツール)での監視」というアプローチを取っています。しかし、次章で詳述するように、これらの対策だけでは生成AIの「対話的な性質」や「文脈依存性」に完全に対応することは困難です。

2. なぜ既存のDLPやファイアウォールでは「プロンプト」を守れないのか

「DLPを導入している」「ファイアウォールがある」という場合でも、生成AIという新しい通信形態に対しては対策が不十分となる可能性があります。その技術的な理由を解説します。

2.1. 文脈(コンテキスト)理解の限界

既存のDLPは、主に「クレジットカード番号」や「特定の機密キーワード」といったパターンマッチング(正規表現)に依存しています。定型的なデータの流出防止には有効ですが、生成AIへのプロンプトは自然言語(会話)で行われます。

- 具体的な課題: 社員がテキストデータを要約・加工して入力した場合、キーワードが含まれていなければDLPは通過させる可能性があります。

- AIセキュリティの必要性: 生成AIセキュリティには、入力データが「知的財産(IP)」なのか、「個人情報(PII)」なのか、あるいは「一般的な会話」なのかを、文脈(セマンティック)から判断する能力が求められます。

2.2. ブラウザ拡張機能とSSL検査の課題

多くの生成AIツールはブラウザ上で動作しますが、セキュリティ対策が不十分なブラウザ拡張機能(プラグイン)を経由してデータが流出するリスクがあります(Man-in-the-Browser攻撃)。

また、ネットワーク層のセキュリティ機器(ファイアウォールやSWG)は、通信がSSL/TLSで暗号化されており、かつサービス側がSSLピンニング等の技術を用いている場合、通信内容を復号・検査することができません。つまり、ネットワーク機器にとって生成AIへの通信は「暗号化されたブラックボックス」となり、内容の判別が困難です。2.3. Prompt Securityのアプローチ:ブラウザ層での防御

これらに対応するには、ブラウザ層(入力の最前線)でプロンプトの内容を検査・制御する仕組みが必要です。ここで有効なのが、生成AIセキュリティに特化した「Prompt Security」です。

Prompt Securityはブラウザ拡張機能として動作するため、データが暗号化される前の段階で、プロンプトの内容を把握できます。

- 文脈理解: 自然言語処理技術を用いて、プロンプトの意味や意図を解析。

- リアルタイム遮断: 機密情報の流出やプロンプトインジェクションを、送信時に検知し、ブロックまたはマスキング(Redaction)を行います。

3. ケーススタディ1:Riskified社に見る「全社的なAI利用の可視化」とガバナンス

EC詐欺防止プラットフォームを提供するRiskified社の事例を紹介します。

3.1. 導入の背景:未知のツールの増加

Riskified社では、開発部門だけでなく、全社的にAIツールの利用が急増していました。CISOのYossi Yeshua氏は、「組織の拡大に伴い、どの部署で誰がAIを利用しているのか把握困難になっていた」と当時の課題を語ります。 特に、社員が業務効率化のために未承認のAIツール(シャドーAI)を利用し、機密情報を入力してしまうリスクが懸念されていました。

3.2. Prompt Securityによる可視化の実現

同社がPrompt Securityを選定した主な理由は、その「可視化(Visibility)」能力です。

- 利用ツールの棚卸し: 社内で使用されている生成AIツールを検出し、リスト化しました。これにより、数百ものツールが利用されている実態が可視化されました。

- リスクの即時検知: PII(個人識別情報)が含まれるプロンプトに対し、リアルタイムで検知・ブロックする体制を構築しました。

3.3. Okta連携による運用効率化

ID管理システム「Okta」との連携により、手動でのポリシー管理を廃止しました。

- 動的なポリシー適用: ユーザーグループ情報に基づき、「エンジニアにはGitHub Copilotを許可」「マーケティングにはJasperを許可」といったポリシーが自動的に適用されます。

4. ケーススタディ2:10x Banking社が実現した「金融レベルの安全性とAI利活用の両立」

次に、高いセキュリティ要件が求められる金融業界の事例として、10x Banking社の取り組みを紹介します。

4.1. 「一律禁止」から「イネーブラー(実現者)」へ

10x Banking社のCISO、Richard Moore氏は、セキュリティチームの役割を、ツールをブロックする「門番」から、ビジネスを支援する「イネーブラー」へと変革することを目指しました。エンジニアや社員からのAI利用要望に対し、「安全に利用できる環境」を提供することを重視したのです。

4.2. 機密情報の自動マスキング

(Redaction)による解決 Prompt Security導入により、以下の制御を実現しました。

- PIIの自動検知・置換: 社員が個人情報などを入力すると、ブラウザ上で自動的に検知され、アスタリスク(*)やダミーデータに置換(Redaction)されてから送信されます。AI側への機密情報流出を防ぎます。

- 知的財産の保護: ソースコードなどの知的財産(IP)が含まれる場合も、同様にブロックまたは無害化されます。

4.3. 導入効果:リスクのコントロール

このアプローチにより、「金融レベルのデータ保護」と「AIツールの利活用」を両立させました。Moore氏は、「リスクを受け入れるのではなく、コントロール下に置くことが重要だ」と述べています。

5. 技術的優位性:MCP時代のリスク管理と「脱獄」検知メカニズム

Prompt Securityは、生成AIの技術進化に対応した防御メカニズムを備えています。

5.1. 「MCP(Model Context Protocol)」への対応

AIが外部ツールと連携する「MCP」の普及に伴い、AIは「エージェント型」へと進化しています。これには新たなリスクが伴います。

- Tool Poisoning: 攻撃者がAIに意図しないツールを実行させる攻撃。

- 過剰な権限: AIエージェントに不適切な権限を与えてしまうリスク。

- Shadow MCP: 管理されていないMCPサーバーが利用されるリスク。

5.2. 最新の「脱獄」手法への対抗策

攻撃手法の高度化に対し、Prompt Securityはセマンティック(意味論)レベルでの解析を行います。LLMを活用した検知エンジンにより、文脈から攻撃意図を読み取り、AIの安全装置を無効化しようとする試みをブロックします。

6. 情報システム部門の運用負荷を大幅に軽減する:「Okta連携」によるポリシー制御

セキュリティポリシーの管理・運用は、情報システム部門にとって大きな負担となりがちです。Prompt Securityは、ID管理ソリューション「Okta」との連携により、この課題を解決します。

6.1. 人事異動に自動追従するポリシー管理

通常、新しいツール導入時にはユーザーグループの作成や割り当て作業が発生します。Prompt SecurityはOktaのユーザーグループ情報(User Groups)を同期して利用できるため、二重管理が不要です。

- マーケティング部: 生成AIの利用を広く許可(顧客データ入力は制限)。

6.2. 運用負荷を最小化する制御

Okta上で社員の所属情報が変更されれば、Prompt Security上のポリシーも自動的に切り替わります。退職者のアカウント無効化も即座に反映されます。 これにより、担当者は煩雑な手作業から解放され、より戦略的な業務に時間を割くことが可能になります。

7. 「禁止」から「安全な活用」へ:Prompt Security導入によるROIと組織変革

7.1. セキュリティリスクの低減(定量的効果)

シャドーAIの可視化とプロンプトレベルでのブロックにより、情報漏えいや攻撃被害のリスクを最小化します。潜在的な侵害コストを未然に防ぐ効果が期待できます。

7.2. 生産性の向上と機会損失の回避(定性的効果)

「安全が担保された状態」でAIツールを開放することで、業務効率の向上やイノベーションの加速が見込めます。AI利用の禁止による競争力の低下を防ぎます。

7.3. 組織変革:「規制主体の管理者」からの脱却

情報システム部門は、一律に禁止する「規制役」から、安全な利用方法を提案する「ビジネスパートナー」へと役割を変えることができます。ユーザーへの教育的な警告メッセージ(Coaching)を通じて、組織全体のセキュリティリテラシー向上にも寄与します。

よくある質問(Q&A)

Q1. 社員のプライベートなGoogle検索や、個人のSNSまで監視されてしまうのでしょうか?(プライバシーへの配慮)

A. いいえ、その心配はありません。Prompt Securityのブラウザ拡張機能は、企業が管理するワークスペースや、業務に関連する生成AIツール(ChatGPT、Claude、Geminiなど)へのアクセスのみを監視対象とするよう設定できます。個人のプライベートなブラウジング、銀行口座へのアクセス、個人のSNSやメール(Gmailの個人アカウントなど)での活動を監視・記録することはありません。プライバシーとセキュリティのバランスを厳格に保つ設計となっています。

Q2. 導入するとブラウザの動作が重くなりませんか?

A. ユーザー体験(UX)を損なわないよう、極めて軽量に設計されています。プロンプトの検査に伴うレイテンシ(遅延)は平均して200ミリ秒(0.2秒)以下です。利用者はセキュリティソフトが裏で動いていることを意識することなく、通常通りのスピードで快適にAIツールを利用し続けることができます。

Q3. 自社開発の社内AIアプリ(Homegrown Apps)も保護できますか?

A. はい、可能です。Prompt Securityはブラウザ拡張機能だけでなく、APIやSDK、またはリバースプロキシ(AI Gateway)経由での統合もサポートしています。これにより、社内開発のチャットボットや、RAG(検索拡張生成)システムに対しても、プロンプトインジェクション対策、PIIフィルタリング、有害コンテンツのブロックをわずか数行のコード変更で適用することができます。

まとめ

AI活用を加速させる「攻め」のセキュリティを 本レポートでは、生成AI時代のリスクと、その解決策としてのPrompt Securityを紹介しました。

- 可視化(Visibility): シャドーAIを把握しリスクを定量化する。

- 制御(Control): Okta連携等により、部署ごとの最適運用を実現する。

- 防御(Protection): 「脱獄」や「MCP」経由の攻撃を高度な技術でブロックする。